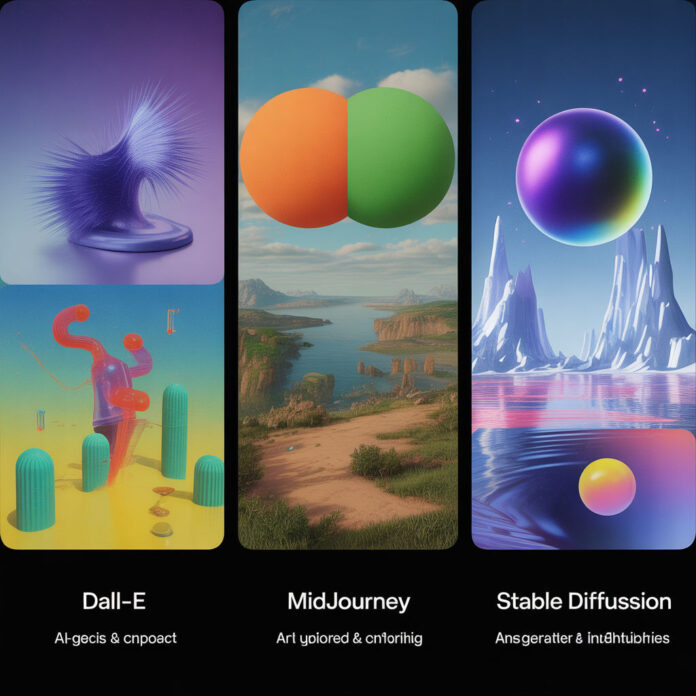

DALL-E vs Midjourney vs Stable Diffusion : trois generateurs d’images IA aux approches tres differentes. Elles ne s’adressent pas aux memes profils ni aux memes budgets. Voici notre comparatif complet pour choisir le bon outil.

DALL-E 3 : l’option la plus accessible

DALL-E 3 est développé par OpenAI et intégré directement dans ChatGPT Plus. C’est de loin l’option la plus simple : vous décrivez ce que vous voulez en langage naturel, et ChatGPT interprète et affine votre demande avant de la transmettre au moteur.

Points forts :

- Compréhension du langage naturel exceptionnelle — pas besoin d’apprendre une syntaxe spécifique

- Intégré dans ChatGPT Plus (20 $/mois) sans surcoût

- Génère du texte lisible dans les images (les autres peinent)

- Parfait pour des illustrations conceptuelles, des visuels marketing, des images pour des articles

Points faibles :

- Style « propre » parfois trop lisse, moins artistique que Midjourney

- Refuse plus facilement certaines demandes (visages réalistes de personnages connus, etc.)

- Moins bon pour le réalisme photographique ultra-précis

Midjourney : le roi du style artistique

Midjourney produit les images les plus « belles » du lot — dans le sens artistique du terme. Son rendu est soigné, avec une attention aux détails visuels que ses concurrents peinent à égaler. C’est l’outil préféré des graphistes, illustrateurs et créatifs.

Points forts :

- Qualité artistique supérieure, style très reconnaissable

- Cohérence visuelle remarquable sur les variations d’une même image

- Communauté massive pour s’inspirer de prompts qui marchent

- Fonctions avancées (pan, zoom, remix, inpainting)

Points faibles :

- Interface via Discord — peu intuitive pour les débutants

- Aucun plan gratuit depuis 2024

- Anglais presque obligatoire pour les prompts complexes

- Génère très mal le texte dans les images

Stable Diffusion : la puissance de l’open source

Stable Diffusion est un modèle open source que vous pouvez faire tourner localement sur votre propre machine. C’est là que tout change : aucune censure, aucun abonnement, contrôle total.

Points forts :

- Gratuit (si vous avez le matériel)

- Aucune restriction de contenu

- Des milliers de modèles spécialisés (photoréalisme, anime, architecture, etc.)

- Contrôle fin via ComfyUI ou Automatic1111 (ControlNet, LoRA, etc.)

- Possibilité d’entraîner des modèles sur vos propres images

Points faibles :

- Courbe d’apprentissage élevée

- Nécessite un GPU puissant (8 Go VRAM minimum, 12+ recommandés)

- Configuration technique requise

- Qualité de base inférieure à Midjourney sans fine-tuning

Comparatif synthétique

| Critère | DALL-E 3 | Midjourney | Stable Diffusion |

|---|---|---|---|

| Facilité d’utilisation | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐ |

| Qualité artistique | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Réalisme photo | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Texte dans les images | ⭐⭐⭐⭐⭐ | ⭐ | ⭐⭐ |

| Prix | Inclus ChatGPT Plus | 10-60 $/mois | Gratuit (local) |

| Liberté de contenu | ⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

Quelle solution choisir ?

Vous débutez et voulez quelque chose qui marche tout de suite : DALL-E 3 via ChatGPT Plus. Aucun apprentissage, résultats corrects immédiatement.

Vous créez des contenus visuels régulièrement et l’esthétique compte : Midjourney. L’investissement en temps pour apprendre l’interface vaut le résultat.

Vous êtes technique, avez un GPU, et voulez un contrôle total : Stable Diffusion avec ComfyUI. La courbe est raide mais le potentiel est illimité.

Mon conseil personnel : commencez par DALL-E 3 pour explorer, puis migrez vers Midjourney si la qualité visuelle devient une priorité. Stable Diffusion est un monde à part — ne l’abordez que si vous êtes prêt à y passer du temps.